- Teknoloji Haberleri,Mobil Telefon,Yazılım Haberleri

- Genel

- Uzmanlar uyardı: ChatGPT’yi bu maksatla kullanmayın!

Uzmanlar uyardı: ChatGPT’yi bu maksatla kullanmayın!

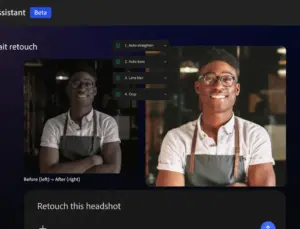

ChatGPT üzere üretken yapay zeka araçlarının kullanımının yaygınlaşması, şahsî bilgiler için yeni tehlikeleri beraberinde getiriyor. Bir siber güvenlik firmasının araştırmasına nazaran, ChatGPT benzeri araçları kullanan şirketler, kapalı bilgilerini ve ticari sırlarını yapay zeka ile paylaşıyor olabilir.

ChatGPT üzere araçlar şirketlerin saklı bilgilerini ifşalayacak

Team8’in yürüttüğü yeni araştırma, bilgisayar korsanlarının saklı kurumsal bilgilere erişmek için ChatGPT’yi kullanabileceğini ortaya çıkardı. Yapay zeka sohbet botları ve öbür yazı araçlarını kullanan şirketler, data sızıntılarına karşı savunmasız kalabilir. Ayrıyeten sohbet botlarına aktarılan dataların silinmesi de epey sıkıntı olabilir.

Rapor, üretken yapay zekayla temaslı bilgi çalınma riskini “yüksek dereceli” olarak sınıflandırdı. Fakat Team8 araştırmacıları, uygun tedbirlerin alınması durumunda risklerin “yönetilebilir” olabileceğini tabir etti. Ayrıyeten ChatGPT’nin oluşturduğu yanlış bilgilerin tehdit oluşturduğuna dikkat çekildi.

Bu telaşlara karşın, Microsoft ve Google gibi teknoloji şirketleri yapay zeka yarışında geri kalmak istemiyor. Lakin rapor, bu araçların zımnî bilgilerle beslenmesi durumunda bilgileri silmenin çok güç olabileceğine dikkat çekti.

Buna ek olarak ChatGPT üzere araçlar, telif hakkı konusunda da tartışmalara yol açtı. Örneğin birçok yazılımcı, kendi kodlarına bakarak yeni kodlar yazdığını düşünüyor. Misal formda sanatkarlar ise yapay zekanın oluşturduğu görsellere karşı çıkıyor.

Siber güvenlik firmasının bu araştırması, ABD Siber Komutanlığı’nın eski Lideri Michael Rogers tarafından da desteklendi. Ayrıyeten birçok firmanın bilgi güvenliği araştırmacısının imzasını içeriyor.

Peki siz ChatGPT üzere araçların şahsî bilgiler için tehlike yaratacağını düşünüyor musunuz? Görüşlerinizi bizimle paylaşın.

Sıradaki haber:

Fotoğraf makinesine dönüşen Xiaomi 13 Ultra!

KATEGORİNİN POPÜLERLERİ

-

1 Birinci Türk astronotun yeni uçuş tarihi açıklandı! 16341 kez okundu

-

2

Fujifilm X-M5 Vlogger kit kutu açılımı!

7222 kez okundu

2

Fujifilm X-M5 Vlogger kit kutu açılımı!

7222 kez okundu

-

3 Apple, çıldırtan iOS güncellemesini geri çekti! 4889 kez okundu

-

4 Microsoft, klavyeye yeni bir tuş kazandırıyor! 30 yılın ardından… 4814 kez okundu

-

5 Dünyanın en çok oynanan MOBA oyunu, Türkiye’ye geliyor! 4748 kez okundu

News

News

Genel

Genel

Genel

Genel

Genel

Genel

Genel

Genel

Genel

Genel

Genel

Genel